Faire de beaux tableaux de bord ne suffit pas pour briller en Data Analysis

Au-delà des Dashboards : Maîtriser l'Architecture et l'Analyse Data de Bout en Bout

Vos graphiques sont superbes ! » C’est le compliment le plus courant que je reçois à la fin d’un projet. Mais pour un Data Analyst expérimenté, c’est aussi un rappel que notre travail est souvent mal compris.

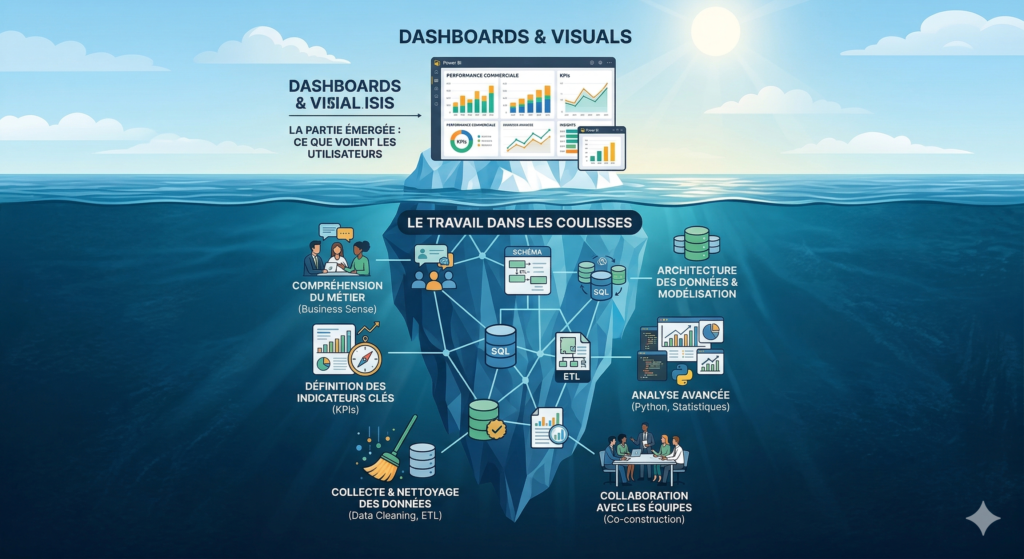

Un beau tableau de bord n’est que la pointe de l’iceberg. C’est la partie visible qui masque une réalité technique complexe et cruciale.

Récemment, j’ai publié un post sur LinkedIn pour déconstruire ce mythe. L’image de l’iceberg a résonné auprès de nombreux professionnels. Sur ce portfolio, je souhaite aller beaucoup plus loin et détailler ce qui se passe réellement dans les coulisses de mon travail, en m’appuyant sur une étude de cas récente : la refonte du système d’analyse de la performance commerciale d’une institution bancaire.

L'Iceberg de la Data Analysis : Une Méthodologie Complète

L’image ci-dessous illustre ma vision de la Data Analysis de bout en bout. J’ai segmenté mon approche en six piliers fondamentaux que je maîtrise pour livrer des solutions pérennes.

Détaillons maintenant chaque section de la partie immergée de l'iceberg.

1. Compréhension du Métier (Business Sense) : Le Cadrage Stratégique

C’est le socle. Comprendre l’outil ne sert à rien si l’on ne comprend pas l’objectif. Dans le cas de l’institution bancaire, j’ai dû :

- Analyser les workflows existants du département commercial.

- Rencontrer les parties prenantes (direction commerciale, chefs de produits, agents de terrain) pour identifier leurs points de friction et leurs besoins réels.

- Formaliser le jargon : une « opportunité » n’a pas la même définition pour le marketing et pour la finance. Maîtriser ce jargon est indispensable pour construire des analyses cohérentes.

- Cadrer les exigences techniques : transformer des souhaits flous (« On veut mieux piloter ») en spécifications fonctionnelles précises.

2. Définition des Indicateurs Clés (KPIs) : L’Alignement des Métriques

Une fois le besoin identifié, il faut mesurer. Maîtriser cette étape, c’est :

- Éviter les « Vanity Metrics » : les métriques qui brillent mais n’ont aucun impact business.

- Construire des indicateurs d’affaires pertinents : dans la banque, nous avons défini des indicateurs de conversion à chaque étape du funnel (Taux de conversion Prospect > Lead > Client), des indicateurs de revenus (ARR, MRR par produit) et des indicateurs de risque (Taux de Churn).

- Concevoir une hiérarchie d’indicateurs : un indicateur global pour la direction, décliné en indicateurs spécifiques pour les équipes opérationnelles.

3. Collecte & Nettoyage des Données (Data Cleaning, ETL) : L’Étape Critique

C’est ici que les problèmes commencent souvent. Les données de la banque étaient :

- Dispersées sur plusieurs systèmes (ERP d’héritage, CRM Salesforce, plusieurs centaines de fichiers Excel).

- Incomplètes et Incohérentes.

Mon travail a consisté à concevoir et exécuter des pipelines ETL (Extract, Transform, Load) robustes :

- Nettoyage approfondi (avec Python/Pandas) : gestion complexe des valeurs manquantes (imputation ciblée vs suppression), correction des anomalies (e.g., des dates de naissance dans le futur), dédoublonnage de clients (fuzzy matching sur les noms et emails).

- Normalisation et Standardisation : harmonisation des formats de dates, des unités de mesure, et des taxonomies de produits entre les différents systèmes.

4. Architecture des Données & Modélisation : Le Fondement de l’Analyse

Pour que les données soient utilisables, elles doivent être structurées. J’ai conçu et déployé une architecture de Data Warehouse cohérente :

- Conception de Schémas (Modélisation Dimensionnelle) : j’ai opté pour un schéma en étoile (Star Schema) sur un moteur SQL dbt, optimisé pour la performance des requêtes de Business Intelligence.

- Architecture Relationnelle : création de tables de faits (transactions, interactions) et de tables de dimensions (clients, produits, temps), avec des clés d’intégration robustes.

- Gouvernance des Données : mise en place de dictionnaires de données pour assurer l’intégrité et la documentation de chaque champ.

5. Analyse Avancée (Python, Statistiques) : Extraire de la Valeur

C’est l’analyse qui transforme la donnée en décision. Si SQL est suffisant pour des rapports simples, j’utilise Python (Pandas, Scikit-learn, Statsmodels) pour des analyses exploratoires complexes :

- Analyses de Cohortes (Cohort Analysis) : identifier l’évolution de la valeur client (CLV) et de la fidélité en fonction de leur date d’acquisition.

- Segmentation de Clientèle : utilisation de modèles de clustering (K-means) pour segmenter les clients bancaires en profils homogènes (e.g., clients à haut potentiel, clients à risque de churn).

- Analyses Prédictives : mise en place de modèles de régression simples pour anticiper la performance commerciale à court terme.

6. Collaboration avec les Équipes (Co-construction) : L’Adoption de l’Outil

Enfin, la solution technique n’est valable que si elle est adoptée. J’ai mené cette étape par :

- Ateliers de Validation des Données (Data Validation Workshops) : des sessions récurrentes pour valider les données de sortie avec les équipes métiers avant la finalisation.

- Formation et Support : formation des équipes commerciales à l’utilisation interactive du dashboard pour qu’ils soient autonomes dans leur pilotage.

Étude de Cas : Refonte de la Performance Commerciale Bancaire

Le Défi Initial

En mission pour une banque, le diagnostic était clair : le pilotage commercial était impossible. Les données étaient le chaos total. Il n’y avait aucun référentiel client unique, les données financières étaient dispersées, et les décisions étaient prises à l’instinct.

Ma Solution Technique

Pendant six mois, je n’ai pas touché à Power BI. J’ai exécuté ma méthodologie de bout en bout :

- J’ai passé deux mois à comprendre les 15 produits bancaires différents et à définir 22 KPIs de performance uniques.

- J’ai conçu un pipeline ETL en Python pour ingérer, nettoyer et fusionner 3 bases de données CRM et ERP différentes, traitant plus de 500 000 transactions.

- J’ai construit un Data Warehouse SQL avec un schéma en étoile, consolidant les données clients et produits de toute l’organisation.

- J’ai appliqué des modèles de segmentation client en Python pour identifier les 10% de clients générant 60% des revenus produits.

Le Résultat

Ce n’est qu’après ce travail de l’ombre que j’ai pu co-construire le dashboard interactif final. Ce que les équipes commerciales voient aujourd’hui est fluide, précis et fiable, car il repose sur une fondation technique robuste. Ce dashboard est devenu l’outil central de pilotage quotidien de la performance.